关于 Scaling Law 的非正式评论

大模型被广泛关注的起点是 OpenAI 发布 ChatGPT,凭借优秀的对话能力与 In-Context Learning 的能力,吸引了整个 AI 圈的关注。

LLM技术的发展主要得益于Scaling Law给出的一系列预测,这些预测主导了最近几年LLM模型在参数、数据和算力规模上快速增长。

甚至有人提出了”Scale is All You Need!”。本文主要讨论LLM行为的可预测性,记录关于Scaling Law、Grokking和Double descent等empirical phenomenon的讨论。

大模型的良好泛化性

OpenAI 在 GPT3 论文中提出 GPT-3 等语言模型(language model)是 few shot learner。这一概念出自 In-Context Learning,具体是指在模型预测时通过上下文中给出足够的背景知识和任务描述,然后直接预测 1,比如:

- Zero-shot(没有示例

) :{8+9=?} - One-shot(一个示例

) :5+5=10, {8+9=?} - Few-shot(多个示例

) :6+7=13,6+6=12,5+5=10, {==8+9=? ==}

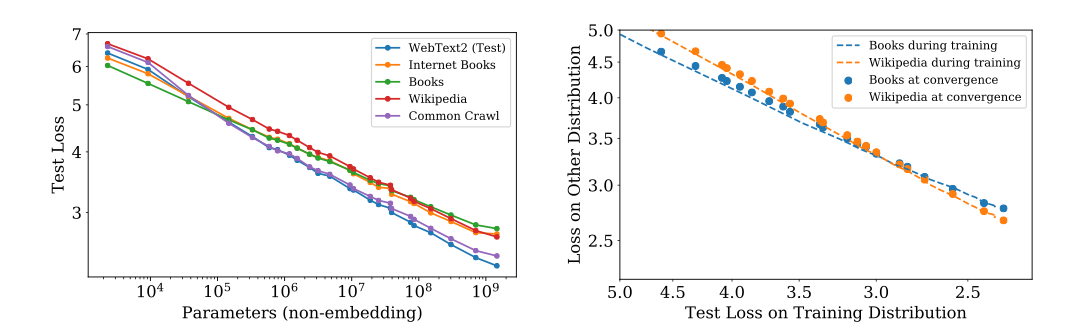

Open AI 在 2020 年的大模型 Scaling Law 论文中发现,若将模型迁移到新的数据集,新数据集上的测试 loss 与训练数据集上的测试 loss 存在一个相对恒定的 offset。随着模型规模的增大,训练数据集和新数据集上的测试 loss 近似同步下降。这也就意味着可以通过持续增大模型大小来降低模型在所有数据集上的 loss。

这种优秀的泛化性给出了一种全新的探索方向:相比探索更复杂的模型结构,探索更大的模型是否能够成为深度学习的全新路径。